Detectan fallos en ChatGPT que exponían datos privados y credenciales de GitHub

Investigadores de seguridad descubrieron que era posible extraer información sensible de conversaciones en ChatGPT sin que el usuario lo supiera. Un simple mensaje malicioso podía convertirse en un canal oculto para robar mensajes, archivos subidos y otros contenidos privados. Además, hallaron un fallo en Codex, la herramienta de IA para programadores de OpenAI, que permitía robar credenciales de GitHub.

Cómo funcionaba el robo de datos en ChatGPT

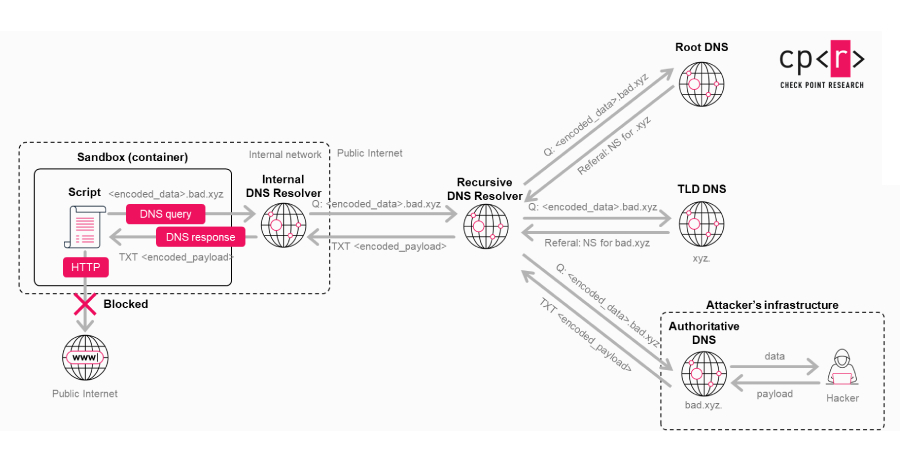

La vulnerabilidad en ChatGPT permitía saltarse las protecciones de la plataforma usando un canal de comunicación oculto basado en peticiones DNS (el sistema que traduce nombres de dominio a direcciones IP). Un atacante podía "empaquetar" la información robada dentro de estas peticiones DNS, evitando que ChatGPT detectara la fuga de datos. Esto permitía incluso ejecutar comandos remotamente en el sistema Linux que usa la IA.

- Un atacante podía engañar al usuario para que pegara un mensaje malicioso haciéndolo pasar por una forma de mejorar ChatGPT o desbloquear funciones premium.

- El problema se agravaba al incrustar esta técnica en GPTs personalizados, ya que la lógica maliciosa podía venir "de fábrica" en lugar de requerir engañar al usuario.

El fallo en Codex y el robo de credenciales de GitHub

Por otro lado, se descubrió una vulnerabilidad de inyección de comandos en Codex. Esto significa que un atacante podía inyectar comandos maliciosos a través del nombre de una rama de GitHub al crear una tarea. Debido a una falta de seguridad al procesar los nombres de las ramas de GitHub, esto permitía robar el token de acceso (una especie de llave) de GitHub del usuario afectado. Con este token, el atacante podía acceder al código de la víctima.

- El problema afectaba a la web de ChatGPT, la interfaz de línea de comandos de Codex, el SDK de Codex y la extensión de Codex para IDEs (entornos de desarrollo integrados).

- El ataque también permitía ejecutar comandos en el contenedor de revisión de código cuando se mencionaba a @codex en GitHub.

Quién lo descubrió y qué hizo OpenAI

Check Point fue quien descubrió la vulnerabilidad de ChatGPT y BeyondTrust Phantom Labs la de Codex. Ambas fueron reportadas a OpenAI, que las solucionó el 20 de febrero de 2026 (la de ChatGPT) y el 5 de febrero de 2026 (la de Codex). No hay evidencia de que estos fallos hayan sido explotados de forma maliciosa.

Qué significa esto para ti

Estos hallazgos demuestran que incluso las herramientas de IA más avanzadas pueden tener fallos de seguridad importantes. Si usas ChatGPT o herramientas similares en tu empresa, es crucial implementar medidas de seguridad adicionales para proteger tus datos contra posibles ataques. No asumas que estas herramientas son seguras por defecto.